Công nghệ hiệu ứng đặc biệt đã chứng kiến một sự bùng nổ thực sự trong vài thập kỷ qua, với CGI chuyển từ thô sơ và thô sơ sang gần như không thể phân biệt được với thực tế. Giờ đây, khi việc tạo ra hình ảnh thô sơ ngày càng trở nên phổ biến, các chuyên gia chính trị và các chuyên gia tư pháp hình sự đều dự đoán một sự hoảng loạn xung quanh cái gọi là công nghệ 'giả sâu', có khả năng làm phức tạp thêm cuộc thảo luận quốc tế đang diễn ra về 'tin giả'. Nhưng chính xác thì 'deep fake' là gì và công nghệ này sẽ gây ra bao nhiêu mối đe dọa trong tương lai?

Cô giáo làm tình với học sinh của họ

Công nghệ giả sâu (đôi khi được cách điệu là 'deepfake') đề cập đến các hình ảnh và / hoặc video được tổng hợp và / hoặc xếp chồng lên nhau do trí tuệ nhân tạo tạo ra bằng cách sử dụng các hình ảnh và video hiện có. Sử dụng máy học, công nghệ này về mặt lý thuyết có thể tạo ra cảnh quay thuyết phục về một người đang thực hiện một hành động chưa bao giờ thực sự xảy ra trong đời thực.

Owen Williams, một kỹ sư phần mềm chuyên nghiệp và nghệ sĩ hiệu ứng hình ảnh, đã đưa ra một lời giải thích đơn giản.

Williams nói: “Đó là một cách sử dụng hệ thống phần mềm tự động để thay thế khuôn mặt của một người trong video bằng một khuôn mặt khác tự động và thuyết phục hơn nhiều so với những gì có thể làm được với công nghệ trước đây. Oxygen.com .

Williams lưu ý rằng những bộ phim chính thống, nổi tiếng như 'Jurassic Park' và 'Blade Runner: The Final Cut' đã sử dụng phần mềm máy tính cho một số cảnh nhất định theo những cách có thể là tiền thân của những trò giả mạo sâu sắc: 'Trong ngành công nghiệp điện ảnh, điều này thực sự phổ biến. Giả sử bạn có một nhân vật cần thực hiện một pha đóng thế và bạn muốn để mặt của họ được nhìn thấy. Cách giải quyết cổ điển là bạn sẽ chỉ nhìn thấy họ từ phía sau hoặc tóc của họ sẽ ở trên khuôn mặt của họ nên bạn không thể biết đó là một đôi. Nhưng có một lịch sử khá liên quan đến việc các nhà làm phim sử dụng máy tính để đưa khuôn mặt của một diễn viên lên trên một đôi diễn viên đóng thế. '

Williams tiếp tục: “Đó từng là một quá trình rất thủ công. 'Bây giờ, với công nghệ giả mạo sâu sắc, bạn cung cấp cho máy tính hai thứ: Đầu tiên là video bạn sẽ thay thế và sau đó là một loạt đầu vào của khuôn mặt mà bạn sẽ thay thế. Bạn phải có đủ hình ảnh của một người có các biểu cảm khuôn mặt khác nhau và từ các góc độ khác nhau. Bạn đang tạo một thư viện về khuôn mặt của người này có thể trông như thế nào trong các tình huống khác nhau, sau đó máy tính sẽ duyệt và xem video. Nó cũng không cần một kết quả chính xác. Nó có thể bóp méo và biến đổi những gì nó có trong thư viện để phù hợp với những gì nó cần. Những gì đã từng yêu cầu hàng chục nghệ sĩ hàng trăm giờ để thử và thực hiện một hiệu ứng thực sự phức tạp giờ chỉ là một nút nhấn. '

Một khía cạnh của công nghệ này khiến mọi người lo lắng là một người không nhất thiết phải sẵn sàng đưa khuôn mặt của họ để quá trình này được thực hiện, xem xét có bao nhiêu bức ảnh tồn tại trên mạng của hầu hết mọi người - đặc biệt là những người nổi tiếng và nhân vật chính trị.

Williams nói: “Có đủ ảnh của bất kỳ người nổi tiếng nào ở đủ góc độ để bạn có thể tạo thư viện đó [mà không cần sự đồng ý]. 'Có một số lượng công việc nhất định cần thiết để làm được điều đó, nhưng đối với bất kỳ nhân vật bình dân nào thì mọi thứ sẽ tồn tại. Cảm giác của tôi là ít có khả năng điều này xảy ra với một người bình thường. '

Các video giả sâu đầu tiên xuất hiện trên diễn đàn Reddit vào cuối năm 2017, theo Variety . Một người dùng tuyên bố đã sử dụng máy tính của mình để tạo các video khiêu dâm có độ chân thực cao về nhiều người nổi tiếng khác nhau tham gia vào các hoạt động tình dục mà thực tế chưa bao giờ xảy ra trong đời thực. Người dùng tuyên bố anh ta đã cho máy tính của mình hàng nghìn bức ảnh về các ngôi sao, từ đó AI có thể tạo nguồn cho các biểu cảm và chuyển động trên khuôn mặt được mô tả. Một ứng dụng được những người tạo giả sâu sử dụng và được chia sẻ trên Reddit cuối cùng đã được tải xuống hơn 100.000 lần. (Reddit cuối cùng sẽ tiếp tục cấm loại nội dung này, nói rằng nó vi phạm chính sách của họ về 'nội dung khiêu dâm không tự nguyện', theo The Verge .)

Williams nghi ngờ tính hiện thực mà phương tiện này có thể đạt được vào lúc này.

Williams nói: “Nếu bạn đã từng thực sự xem một trong những trò giả mạo sâu sắc này ... thì sẽ có một số điều kỳ lạ nhất định ở đó. 'Chúng không được đánh bóng. Tuy nhiên, nó có thể sẽ ngày càng tốt hơn, đặc biệt là vì Hollywood quan tâm đến việc tạo ra điều này tự động hơn là trả tiền cho các nghệ sĩ đắt tiền. '

Tương tự, Williams đoán rằng mặc dù sự hoảng loạn xung quanh phim khiêu dâm giả sâu , thái độ văn hóa thay đổi xung quanh bản chất của những thứ như khiêu dâm trả thù hoặc hình ảnh khỏa thân bị rò rỉ có nghĩa là những người tạo ra loại phương tiện truyền thông này sẽ bị lên án và không được tôn vinh, ngay cả trong ngành công nghiệp giải trí người lớn.

Williams giả thuyết: “Nó sẽ không bao giờ là xu hướng chủ đạo. 'Sau ' Fappening 'điều đã xảy ra trên Reddit, mọi người có thể thay đổi cuộc trò chuyện và nói,' Đây không phải là một vụ bê bối, đó là một tội phạm tình dục. ' Vì vậy, tôi không thấy điều này trở thành một vụ bê bối nhiều như mọi người nghĩ. Mọi người cũng có thể khá dễ dàng tìm thấy nội dung khiêu dâm gốc mà từ đó giả mạo sâu sắc được tạo ra, có nghĩa là nó khá dễ dàng để gỡ rối. '

trẻ em Britney spears bao nhiêu tuổi

Nhưng nó không chỉ gây lo lắng bởi vì nó có thể được sử dụng để tạo phim khiêu dâm người nổi tiếng giả. Mọi người cũng lo lắng về các phân nhánh chính trị.

Các chuyên gia chính trị đã bắt đầu viết về sự gia tăng của những trò giả mạo sâu sắc vào năm 2018. Một bài báo của Guardian từ tháng 11 năm đó đã ghi nhận sự lan truyền mạnh mẽ của một video được cho là mô tả cảnh Tổng thống Donald Trump khuyến khích quốc gia Bỉ rút khỏi Thỏa thuận Khí hậu Paris. Điều này đã thúc đẩy một cuộc thảo luận lớn hơn về khả năng các chính phủ khác nhau sử dụng công nghệ này trong các chiến dịch thông tin sai lệch hàng loạt, một cuộc trò chuyện đã được bắt đầu nhờ cuộc điều tra đang diễn ra về sự tham gia của Nga trong cuộc bầu cử tổng thống Hoa Kỳ năm 2016.

Sự hoảng loạn xung quanh những sự giả mạo sâu sắc thậm chí còn truyền cảm hứng cho ban biên tập của Bloomberg Media Group để viết một bài báo mạnh mẽ về vấn đề này.

'Bằng chứng video đã trở thành trụ cột của hệ thống tư pháp-hình sự ... chính vì phim có vẻ giống như một bản ghi đáng tin cậy về lời nói hoặc hành động của ai đó. Giả mạo sâu sắc có thể khiến bằng chứng như vậy bị nghi ngờ, ' Họ viết vào tháng 6 năm 2018. 'Sau đó, một thách thức lớn hơn sẽ là xác định và gọi ra những giả mạo này - nếu điều đó có thể. '

Williams đồng tình rằng bản chất của những vụ giả mạo sâu sắc đe dọa quan niệm của chúng ta về 'thực tế' liên quan đến bằng chứng video, nhưng lưu ý rằng vũng lầy pháp lý này không phải là duy nhất đối với bối cảnh kỹ thuật số hiện đại của chúng ta.

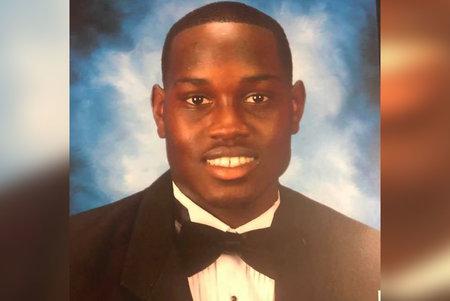

'Điều này nảy sinh ý tưởng rằng mọi người coi video đó là sự thật, điều này chưa bao giờ xảy ra. Chúng tôi đã biết điều này từ Rodney King trở đi. Hoặc, nghĩ về Eric Garner : Mọi người nghĩ rằng [sĩ quan đã giết anh ta] vô tội cho dù video về vụ việc được dự đoán như thế nào. Đối với tôi [rất nhiều nỗi sợ hãi xung quanh hàng giả sâu sắc] dường như hơi vô căn cứ. '

Williams đã liệt kê một số sự cố khác không liên quan đến công nghệ giả mạo sâu sắc cho thấy các cách video đã bị thao túng một cách táo bạo để đánh lừa dư luận về một vấn đề, như Vụ gỡ xuống ACORN gây tranh cãi của James O'Keefe và một vụ bê bối gần đây liên quan đến video có nội dung được cho là mô tả phóng viên CNN Jim Acosta tấn công một nhân viên Nhà Trắng .

Kết luận cuối cùng của Williams là sự cuồng loạn xung quanh những điều giả tạo sâu sắc có phần bị thổi phồng quá mức.

'Những gì tôi thấy đang xảy ra là, nó sẽ hoạt động theo cả hai cách. Nếu một video xuất hiện và đó là video thật, mọi người sẽ cho rằng đó là video giả. Nếu một video xuất hiện và đó là giả, mọi người sẽ khẳng định đó là video thật. Mỗi trường hợp giả định một lượng sự thật nhất định được gán cho video [chính nó]. Thật khó để biết tất cả điều này sẽ đi theo hướng nào. Nếu Băng Pee thực sự ra đời, ví dụ, bạn biết chính xác điều gì sẽ xảy ra: Một nửa số người sẽ nói, 'Đây là con bò đực - t, đó là một diễn viên nào đó!' và một nửa số người sẽ nói, 'Đây rồi! Đó là sự thật!' Vì vậy, sẽ không có gì thực sự thay đổi. Đó có xu hướng là những gì xảy ra với công nghệ mới: Mọi thứ không thay đổi nhiều như mọi người nghĩ. '

[Ảnh: SAUL LOEB / AFP / Getty Images]